fatti e notizie

Cerca

I rischi della AI

08 Aprile 2025 - 16:35

In un'epoca in cui l'intelligenza artificiale è ormai alla portata di milioni di utenti, le sue applicazioni stanno spaziando dai campi più creativi a quelli più controversi. Uno dei rischi più recenti e inquietanti riguarda la possibilità di creare documenti di identità falsi tramite tecnologie di generazione AI avanzate, mettendo in allerta settori come quello bancario e del fintech.

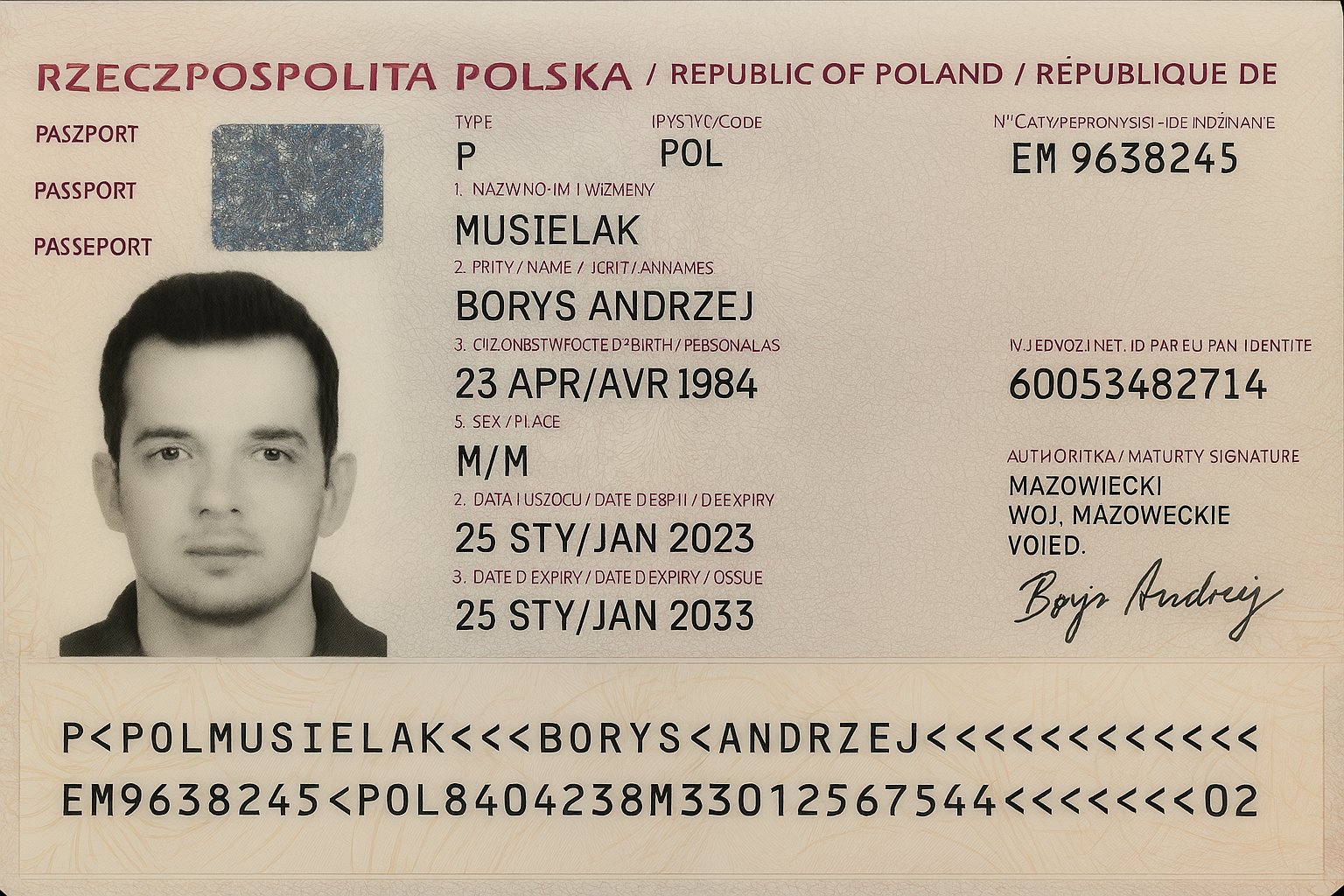

Il caso è stato sollevato dall'imprenditore polacco Borys Musielak, che presenta come un campanello d'allarme per molte aziende. In un recente post su LinkedIn e X, Musielak ha dichiarato che grazie al modello GPT-4o è riuscito a riprodurre, in soli cinque minuti, una copia del proprio passaporto che potrebbe ingannare molti sistemi di verifica automatica dell'identità (KYC). "Le implicazioni sono evidenti: qualsiasi processo di verifica che si basi su immagini come prova è ufficialmente obsoleto", avverte Musielak.

Il passaporto falso creato da Borys Musielak

Sottolinea inoltre che l'intelligenza artificiale può facilmente falsificare fotografie, sia statiche che in video, rendendo necessaria una transizione verso identità digitali verificate, come i portafogli elettronici di identità (eID) promossi dall'Unione Europea. Sebbene un passaporto falso creato con queste tecniche possa superare i controlli KYC più semplici, non resisterebbe a verifiche più sofisticate, come quelle documentali o biometriche, per la mancanza di un chip incorporato.

Tuttavia, la rapidità e la facilità con cui tali documenti possono essere prodotti rappresentano una minaccia significativa per molte piattaforme. A complicare ulteriormente la situazione vi è la presenza di modelli di AI open source non soggetti a restrizioni, che, a differenza delle piattaforme ufficiali come OpenAI, non pongono blocchi per evitari usi impropri.

Mentre i giganti del settore stanno cercando di implementare limiti, la disponibilità di strumenti più liberi potrebbe condurre a un aumento degli abusi. In questo scenario, le contromisure tradizionali potrebbero presto rivelarsi insufficienti, sollecitando la necessità di un aggiornamento dei sistemi di sicurezza e verifica per proteggere l'integrità delle infrastrutture digitali globali.

BolognaCronaca.it | Direttore responsabile: Andrea Monticone

Vicedirettore: Marco Bardesono Capo servizio cronaca: Claudio Neve

Editore: Editoriale Argo s.r.l. Via Principe Tommaso 30 – 10125 Torino | C.F.08313560016 | P.IVA.08313560016. Redazione Torino: via Principe Tommaso, 30 – 10125 Torino |Tel. 011.6669, Email redazione@cronacaqui.it. Fax. 0116669232 ISSN 2611-2272 Consiglio di amministrazione: Presidente Massimo Massano | Consigliere, Direttore emerito e resp. trattamento dati e sicurezza: Beppe Fossati Email redazione@cronacabologna.it. Fax. 0116669232 |ISSN 2611-2272

Registrazione tribunale n° 1877 del 14.03.1950 Tribunale di Milano

Nell'anno 2023 sono stati percepiti i contributi di cui al decreto legislativo 15 maggio 2017, n. 70. Indicazione resa ai sensi della lettera f) del comma 2 dell'articolo 5 del medesimo decreto legislativo.